| 1C |

22.03.26

✎

12:12

ИИ помощник со встроенным MCP сервером, который работает прямо внутри Конфигуратора. Автодополнение кода, ревью, исправление ошибок, доработка методов, документирующие комментарии — всё без переключения из Конфигуратора.

Теперь полноценная работа с ИИ доступна не только в 1C:EDT, но и в классическом Конфигураторе. Не надо больше переключаться между чатом с ИИ и Конфигуратором, копировать и вставлять код. Confaster работает прямо внутри Конфигуратора, видит весь код текущего модуля. А если сделать выгрузку конфигурации, то подключится еще и локальный MCP сервер, который поможет ИИ ориентироваться по всей конфигурации.

На текущий момент реализованы такие функции:

Автодополнение кода

Вы пишите код, Confaster анализирует контекст - название функции\процедуры, окружающий код в модуле и предлагает продолжение кода прямо в редакторе. Применить подсказку можно нажав клавишу Tab. Код автоматически порционно вставится сразу после курсора.

Если подсказка будет надоедать или мешать, ее интенсивность можно отрегулировать в настройках, либо вовсе отключить.

Доработка и исправление кода

Выделите участок кода, который надо доработать или исправить, выберите соответствующий пункт в контекстном меню и опишите, что ИИ должен сделать. Либо можно просто установить курсор внутри функции или процедуры, если пожелание к доработке относятся ко всему методу. Предложенная доработка или исправление сразу же будет применено и отразится в Конфигураторе.

При необходимости можно отключить авто-применение исправлений\доработок и просто копировать результат из чата.

Объяснение и Ревью кода

Просто поставьте курсор внутри функции или процедуры, либо выделите непонятный участок кода и попросите Confaster объяснить его или провести ревью.

Документирующий комментарий

Установите курсор внутри процедуры или функции, выберите действие «Документирующий комментарий» — и ИИ сгенерирует полное описание: назначение, параметры и возвращаемое значение. Готовый комментарий автоматически вставляется перед методом.

MCP-сервер: расширенный контекст для ИИ

В помощника встроен MCP сервер, который помогает ИИ-моделям понимать не только текущий модуль, а контекст всей конфигурации

Чтобы MCP сервер работал необходимо выгрузить конфигурацию. Сделать это можно прямо из контекстного меню в редакторе кода.

После выгрузки MCP-сервер подключается автоматически. Теперь при запросе от ИИ он предоставляет расширенную информацию:

-Если ИИ при объяснении кода обнаруживает вызов метода из другого модуля, MCP-сервер пришлёт код этого метода.

-Если ИИ нужна структура справочника, документа или другого объекта метаданных — MCP-сервер предоставит и её.

-Если ИИ запросит информацию о том, где ссылка на текущий объект используется, MCP-сервер так же пришлет эту информацию.

И многое другое, что может запросить модель ИИ у агента.

Чтобы MCP сервер отдавал актуальный контекст, регулярно делайте выгрузку конфигурации. Во время сеанса работы в Конфигураторе только первая выгрузка может занять длительное время, все последующие выгрузки (если не закрывать Конфигуратор), будут происходить очень быстро.

Поддерживаемые модели

Confaster работает со всеми популярными моделями, в том числе с 1С:Напарник, ChatGPT, Claude, Gemini, DeepSeek и другими. Причем зарубежные модели работают через шлюз OpenRouter, что позволяет работать с ними без использования VPN или прокси.

Бесплатный вариант: На текущий момент 1С предоставляет доступ к своей ИИ модели «1С:Напарник» бесплатно, достаточно зарегистрироваться на ИТС и получить ключ на сайте Напарника ( https://code.1c.ai/tokens/ ).

Как начать работу с Confaster

Чтобы начать работать с помощником достаточно указать API ключ для нужной модели в настройках. Для этого щелкните по значку помощника в трее около часов и выберите пункт Настройки и укажите бесплатный токен от 1С:Напарника, либо свой ключ от шлюза OpenRouter.

Так же на компьютере должен быть установлен .NET Desktop Runtime. Если он не установлен, программа сама предложит его скачать с сайта Microsoft ( https://dotnet.microsoft.com/en-us/download/dotnet/8.0 ).

Сайт проекта https://confaster.ru/

Теперь полноценная работа с ИИ доступна не только в 1C:EDT, но и в классическом Конфигураторе. Не надо больше переключаться между чатом с ИИ и Конфигуратором, копировать и вставлять код. Confaster работает прямо внутри Конфигуратора, видит весь код текущего модуля. А если сделать выгрузку конфигурации, то подключится еще и локальный MCP сервер, который поможет ИИ ориентироваться по всей конфигурации.

На текущий момент реализованы такие функции:

Автодополнение кода

Вы пишите код, Confaster анализирует контекст - название функции\процедуры, окружающий код в модуле и предлагает продолжение кода прямо в редакторе. Применить подсказку можно нажав клавишу Tab. Код автоматически порционно вставится сразу после курсора.

Если подсказка будет надоедать или мешать, ее интенсивность можно отрегулировать в настройках, либо вовсе отключить.

Доработка и исправление кода

Выделите участок кода, который надо доработать или исправить, выберите соответствующий пункт в контекстном меню и опишите, что ИИ должен сделать. Либо можно просто установить курсор внутри функции или процедуры, если пожелание к доработке относятся ко всему методу. Предложенная доработка или исправление сразу же будет применено и отразится в Конфигураторе.

При необходимости можно отключить авто-применение исправлений\доработок и просто копировать результат из чата.

Объяснение и Ревью кода

Просто поставьте курсор внутри функции или процедуры, либо выделите непонятный участок кода и попросите Confaster объяснить его или провести ревью.

Документирующий комментарий

Установите курсор внутри процедуры или функции, выберите действие «Документирующий комментарий» — и ИИ сгенерирует полное описание: назначение, параметры и возвращаемое значение. Готовый комментарий автоматически вставляется перед методом.

MCP-сервер: расширенный контекст для ИИ

В помощника встроен MCP сервер, который помогает ИИ-моделям понимать не только текущий модуль, а контекст всей конфигурации

Чтобы MCP сервер работал необходимо выгрузить конфигурацию. Сделать это можно прямо из контекстного меню в редакторе кода.

После выгрузки MCP-сервер подключается автоматически. Теперь при запросе от ИИ он предоставляет расширенную информацию:

-Если ИИ при объяснении кода обнаруживает вызов метода из другого модуля, MCP-сервер пришлёт код этого метода.

-Если ИИ нужна структура справочника, документа или другого объекта метаданных — MCP-сервер предоставит и её.

-Если ИИ запросит информацию о том, где ссылка на текущий объект используется, MCP-сервер так же пришлет эту информацию.

И многое другое, что может запросить модель ИИ у агента.

Чтобы MCP сервер отдавал актуальный контекст, регулярно делайте выгрузку конфигурации. Во время сеанса работы в Конфигураторе только первая выгрузка может занять длительное время, все последующие выгрузки (если не закрывать Конфигуратор), будут происходить очень быстро.

Поддерживаемые модели

Confaster работает со всеми популярными моделями, в том числе с 1С:Напарник, ChatGPT, Claude, Gemini, DeepSeek и другими. Причем зарубежные модели работают через шлюз OpenRouter, что позволяет работать с ними без использования VPN или прокси.

Бесплатный вариант: На текущий момент 1С предоставляет доступ к своей ИИ модели «1С:Напарник» бесплатно, достаточно зарегистрироваться на ИТС и получить ключ на сайте Напарника ( https://code.1c.ai/tokens/ ).

Как начать работу с Confaster

Чтобы начать работать с помощником достаточно указать API ключ для нужной модели в настройках. Для этого щелкните по значку помощника в трее около часов и выберите пункт Настройки и укажите бесплатный токен от 1С:Напарника, либо свой ключ от шлюза OpenRouter.

Так же на компьютере должен быть установлен .NET Desktop Runtime. Если он не установлен, программа сама предложит его скачать с сайта Microsoft ( https://dotnet.microsoft.com/en-us/download/dotnet/8.0 ).

Сайт проекта https://confaster.ru/

гуру

07.05.26

✎

09:40

(214) Они утверждают что EDT используется наравне с Конфигуратором или сравнимо?

Имхо тогда нагло врут

Неоднократно сталкивался что с конкретной версией платформы 1С это EDT тупо не работает

Предыдущая версия EDT еще, а текущая версия уже требует более новую платформу

Имхо тогда нагло врут

Неоднократно сталкивался что с конкретной версией платформы 1С это EDT тупо не работает

Предыдущая версия EDT еще, а текущая версия уже требует более новую платформу

гуру

07.05.26

✎

09:41

а на сырую 7.7 агентов прикрутят?

гуру

07.05.26

✎

09:44

(216) Там же Телепат ДЛЛ есть! Сам прикрути через vbscript

гуру

07.05.26

✎

09:45

(217)+ Как это ни странно но 1С 7.7 была самая доступная и открытая для модификаций и доработок

07.05.26

✎

09:59

(215) нет, не утверждают, это другое и понятно почему ЕДТ и Элемент. Для развития агентского режима ИИ нужны файлики а не бинарный сf. И опять же без гита "натравливать" агента-ИИ на код это бред, он поломает код и не сделаешь diff потом чо он там натворил.

гуру

07.05.26

✎

10:11

(219) Ты же в курсе что выгрузка конфы в файлики для работы EDT - это специально добавленная в платформу 1С фича?

Причем умеет частичную выгрузку!

Причем умеет частичную выгрузку!

07.05.26

✎

10:32

(211) Отказался от турбокнфа, в пользу этого замечательного инструмента)

Автор, монетизируй уже потиху)

Ток не жадничай, как турбоконф)))

Автор, монетизируй уже потиху)

Ток не жадничай, как турбоконф)))

07.05.26

✎

10:37

(221) + 1 Турбоконф, ты давай допиливай до (0) а то мы в январе только подписку на год купили ))

07.05.26

✎

10:44

(222) Турбоконф отличный, ток конфастер лучше) Покупал турбо, но вот надо было мне дофига помощи по встроенным функциям (типа, получить данные контрагента по БСП и т.д.), турбоконф фигю выдавал, а конфастер все разобрал по полочкам и выдал то что надо)

07.05.26

✎

10:48

(220) я конечно в курсе, я не пользую ЕДТ (вернее отказался от него) и "натравливаю" на файлики связку kilocode + vs code. И даже есть на гитхабе тулза которая прямо из vs code загружает только измененные файлики обратно.

07.05.26

✎

10:48

(223) c ирАдаптер он еще лучше )

07.05.26

✎

11:51

(210) > Так древнее просто нет смысла

семерка шустрее. и ваще я потроград.

семерка шустрее. и ваще я потроград.

07.05.26

✎

11:52

(218) а как же фузина :)

12.05.26

✎

11:32

Вышло обновление Confaster v1.1.6

- Добавлена поддержка COM-подключения для платформы 1С 8.5.

- Значительно ускорен и оптимизирован поиск по конфигурации.

- В настройках можно добавлять несколько OpenAI-совместимых моделей. Для опытных пользователей появились расширенные параметры каждой модели.

- Расширенная настройка BSL Language Server: категории проверок и уровень важности замечаний.

- Окно чата можно развернуть на весь экран — удобно при работе с двумя и более мониторами.

- Скролл в чате больше не «прилипает» к низу во время вывода ответа ИИ — можно спокойно листать историю вверх.

- Добавлены кнопки увеличения и уменьшения шрифта в чате (также работает Ctrl + колесо мыши).

- Окна «Доработать» и «Исправить» теперь можно изменять по размеру.

- Добавлена поддержка COM-подключения для платформы 1С 8.5.

- Значительно ускорен и оптимизирован поиск по конфигурации.

- В настройках можно добавлять несколько OpenAI-совместимых моделей. Для опытных пользователей появились расширенные параметры каждой модели.

- Расширенная настройка BSL Language Server: категории проверок и уровень важности замечаний.

- Окно чата можно развернуть на весь экран — удобно при работе с двумя и более мониторами.

- Скролл в чате больше не «прилипает» к низу во время вывода ответа ИИ — можно спокойно листать историю вверх.

- Добавлены кнопки увеличения и уменьшения шрифта в чате (также работает Ctrl + колесо мыши).

- Окна «Доработать» и «Исправить» теперь можно изменять по размеру.

12.05.26

✎

11:46

(228) - В настройках можно добавлять несколько OpenAI-совместимых моделей. Для опытных пользователей появились расширенные параметры каждой модели.

пожелание, добавить кнопку скопировать между добавить и удалить. чтобы не вводить параметры заново, а только поменять модель. ну и проверка что такая связка провайдер+модель уже есть в списке

пожелание, добавить кнопку скопировать между добавить и удалить. чтобы не вводить параметры заново, а только поменять модель. ну и проверка что такая связка провайдер+модель уже есть в списке

12.05.26

✎

12:52

(216) А надо?

Сколько осталось жить 7.7 ?

Сколько осталось жить 7.7 ?

12.05.26

✎

15:59

(230) вполне возможно что больше чем части форума)

гуру

12.05.26

✎

17:14

(231) "Проблема 2038 года в 1С 7.7 связана с ограничением 32-битных систем, которые перестают корректно обрабатывать даты после 19 января 2038 года. Платформа 7.7 официально не поддерживает даты выше 2037 года и выдает ошибку при запуске, если системная дата превышает этот порог"

но кто ж запретит использовать стюардессу и далее?

но кто ж запретит использовать стюардессу и далее?

12.05.26

✎

20:23

(232) В то время, как наши космические MCP-серверы бороздят просторы восьмёрки, они вычисляют сроки жизни семёрки...

13.05.26

✎

00:36

(231) вот вот. клепают пока документы, декларации здают и не жужжат..

13.05.26

✎

00:40

(234) 🔥

13.05.26

✎

14:24

А может кто-нибудь примеры привести как вы пользуетесь этим ИИ?

Какие вопросы задаёте и какие ответы получаете. Хочется понять варианты практического применения, научиться задавать вопросы ИИ

Какие вопросы задаёте и какие ответы получаете. Хочется понять варианты практического применения, научиться задавать вопросы ИИ

гуру

13.05.26

✎

14:30

(236) ну и вопросы у вас! - ответил ИИ и повесился

13.05.26

✎

15:16

(237)Точно, спрошу у ИИ что он умеет

13.05.26

✎

15:58

(236) Вопросы задаются простым человеческим языком. Языком ведь ты владеешь хоть как-то? Здесь нечему учиться.

Только практическое применение ИИ это не вопросы. Вопросы это 1% пользы.

Основная польза в создании своих аватар, их еще называют агентами

Только практическое применение ИИ это не вопросы. Вопросы это 1% пользы.

Основная польза в создании своих аватар, их еще называют агентами

13.05.26

✎

16:07

(239)Что за аватары и агенты? Расскажите про них, я чёт первый раз слышу про такое

13.05.26

✎

16:16

(240) один аватар, а другой агент

|

13.05.26

✎

16:26

(240) Ты создаешь агента, который представляет тебя перед людьми или другими агентами в различных жизненных ситуациях. Самый простой пример. Представь себе, что ты продаешь что-то. Люди, прежде чем купить, задают миллион вопросов. Ты не тратишь свое время на то, чтобы объяснять одно и то же каждому. Кроме того, может случиться так, что с тобой захотят поговорить сразу 10 человек. Для тебя лично это проблема, для аватары нет. Она ответит и днем и ночью, всем и каждому. А есть еще и другие агенты. Они тоже задают вопросы, но не всегда по человечески. Т.е. они могут и по человечески, но в общении агент-агент это будет неэффективно. Поэтому ты снабжаешь аватару способностью общаться с агентами.

В общих чертах так.

В общих чертах так.

гуру

13.05.26

✎

16:38

(242) краб (компуктерный работничек) = так правильнее, чем агент?

13.05.26

✎

16:41

(242)Я не понял. Аватары и агенты применимы в контексте данной темы? Я про 1С напарник, Confaster, вот это всё.

У меня вопрос то был в (236) про этот ИИ интерфейс.

Я по большей части пробовал использовать его для получения примеров кода, или инфы из БСП. По сути это более удобная альтернатива синтаксис помощнику и гуглу.

Но я только начинаю использовать это в работе и возможно не знаю на что он ещё способен, поэтому и спрашиваю как ещё люди используют ИИ для решения своих ОдинЭсных задач.

Аватары и агенты я так понял не про 1С это, да?

У меня вопрос то был в (236) про этот ИИ интерфейс.

Я по большей части пробовал использовать его для получения примеров кода, или инфы из БСП. По сути это более удобная альтернатива синтаксис помощнику и гуглу.

Но я только начинаю использовать это в работе и возможно не знаю на что он ещё способен, поэтому и спрашиваю как ещё люди используют ИИ для решения своих ОдинЭсных задач.

Аватары и агенты я так понял не про 1С это, да?

гуру

13.05.26

✎

16:45

(242) Не мог просто ответить:

MCP-сервер это тоже софт-прокладка, для ИИ, примерно тоже самое что и Агенты но более специфическое и ограниченное

Чаще предназначено не для действий а для получения инфы, обычно безопасней разрешать

Агент - это ты по сути дал ИИшке доступ к командной строке своего компа - и она может любые команды хреначить автоматом или после твоего подтверждения каждой

И ответ читать, что произошло после команды

Агент это софт-прокладка между ИИ (LLM) и устройством

Которая позволяет ИИ выполнять нужные действия на устройстве, не только текстом отвечать или картинками в чате

Которая позволяет ИИ выполнять нужные действия на устройстве, не только текстом отвечать или картинками в чате

MCP-сервер это тоже софт-прокладка, для ИИ, примерно тоже самое что и Агенты но более специфическое и ограниченное

Чаще предназначено не для действий а для получения инфы, обычно безопасней разрешать

Агент - это ты по сути дал ИИшке доступ к командной строке своего компа - и она может любые команды хреначить автоматом или после твоего подтверждения каждой

И ответ читать, что произошло после команды

13.05.26

✎

16:43

(243) Дело не в словах, а в смыслах. Можно обращаться к общечеловеческому разуму. Т.е. задавать вопросы ИИ или даже поручать ИИ выполнить какую-то работу. Но во всем этом, как я уже сказал, не много пользы

гуру

13.05.26

✎

16:44

(246)

У тебя наконец наступил следующий этап понимания? :)

Но во всем этом, как я уже сказал, не много пользы

У тебя наконец наступил следующий этап понимания? :)

13.05.26

✎

16:44

(245) Эта ваша простота не правильная

13.05.26

✎

16:48

(244) Да, это не про 1С

гуру

13.05.26

✎

16:52

(249) Ты ошибаешься

Уже многие кодят в VS Code с агентами (Cline и прочие) выгрузив конфу 1С в файлы

Уже многие кодят в VS Code с агентами (Cline и прочие) выгрузив конфу 1С в файлы

гуру

13.05.26

✎

16:54

Проблема что LLM-ки все заразы бредят при попытке написания кода на 1С

Подключить справочник по языку (например как MCP-сервер) чуть помогает но не фонтан

В отличие от вайбкодинга на популярных языках

Подключить справочник по языку (например как MCP-сервер) чуть помогает но не фонтан

В отличие от вайбкодинга на популярных языках

13.05.26

✎

17:13

(251) На популярных тоже не так гладко все. Иначе бы сам Anthropic не набирал разработчиков.

гуру

13.05.26

✎

17:48

(252) Там проблемы не на уровне языка как в 1С с фейковыми командами

Проблемы выше начинаются

Например когда путаница во фреймворках/либах

Причем и среди разных версий версий одного и когда тупо фреймворки путает совершенно разные

Выглядит это смешно

Но самая проблема это переполнение контекста

Чем больше его длина - тем хуже LLM воспринимает середину, легко теряет контекст

Только начало и конец помнит а что в промежутке было упс

Проблемы выше начинаются

Например когда путаница во фреймворках/либах

Причем и среди разных версий версий одного и когда тупо фреймворки путает совершенно разные

Выглядит это смешно

Но самая проблема это переполнение контекста

Чем больше его длина - тем хуже LLM воспринимает середину, легко теряет контекст

Только начало и конец помнит а что в промежутке было упс

гуру

13.05.26

✎

17:46

В итоге на сложных задачах - проще самому подумать и сделать чем ИИшке промпт еще готовить

Вайб-кодинг оно работает когда задачи простые, типовые, разжеванные уже многие тысячи раз

В этом случае да, ускорение офигенное

Например даешь пару скринов где десятки и более реквизитов пары объектов и говоришь - напиши сопоставление

И оно да вполне нормально и главное быстро сопоставляет, когда имена реквизитов отличаются между конфами/метаданными

Часто требуется при загрузка/выгрузках по неким форматам - вполне типовая задачка

Вайб-кодинг оно работает когда задачи простые, типовые, разжеванные уже многие тысячи раз

В этом случае да, ускорение офигенное

Например даешь пару скринов где десятки и более реквизитов пары объектов и говоришь - напиши сопоставление

И оно да вполне нормально и главное быстро сопоставляет, когда имена реквизитов отличаются между конфами/метаданными

Часто требуется при загрузка/выгрузках по неким форматам - вполне типовая задачка

13.05.26

✎

17:55

(253) А 90% работы у современных разрабов это как раз небольшие мини приложения, и там Claude идеален. Но это все равно что в 1С дорабатывать не ЕРП, а небольшую самопись с пятью документами и десятком справочников.

И когда потребуется отдать Claude весь корпоративный код, да еще и в идеале какой-то набор тестовых данных скорее всего основанных на реальных, то ни по каким стандартам безопасности это не пройдет.

И когда потребуется отдать Claude весь корпоративный код, да еще и в идеале какой-то набор тестовых данных скорее всего основанных на реальных, то ни по каким стандартам безопасности это не пройдет.

13.05.26

✎

18:02

(254) Можно вспомнить как писались бизнес-приложения до 1С. Это отдельно каждый запрос к БД, серверную часть, клиентскую. Там такой фарш из технологий. И поэтому таким занимались только крупные компании. 1С пришла с лозунгом, "Теперь каждый бухгалтер сможет сам!".

Чем закончилось вы видите сейчас. Даже отдельные направления в 1С появились. Консультанты, аналитики. С ростом возможности, геометрически растут потребности.

Чем закончилось вы видите сейчас. Даже отдельные направления в 1С появились. Консультанты, аналитики. С ростом возможности, геометрически растут потребности.

гуру

13.05.26

✎

18:04

(255) Совершенно верно

(256) Большая часть это наоборот куча простых задач

И даже сложные если подумать можно декомпозировать на простые

Но это дофига времени надо живого умного обученного спеца с опытом

(256) Большая часть это наоборот куча простых задач

И даже сложные если подумать можно декомпозировать на простые

Но это дофига времени надо живого умного обученного спеца с опытом

13.05.26

✎

21:24

(244) Вы можете установить курсор на нужную процедуру или функцию и сразу попросить доработать именно ее, так, как вам надо.

Либо просто в чате написать, что надо сделать такой-то функционал, программа сама откроет нужные модули и напишет нужный код.

Либо просто в чате написать, что надо сделать такой-то функционал, программа сама откроет нужные модули и напишет нужный код.

14.05.26

✎

07:52

Я не жалуюсь, я бурчу: когда открыто несколько конфигураторов (а в моих сценариях минимум 2, в среднем 4-5), то у Confaster теряется: шестерёнка не появляется, и 1Ска крашится внезапно, причем может и конфигуратор, так и предприятие. И от платформы не зависит, у меня их зоопарк. Собственно, та же проблема есть у TurboConf, они же какой-то похожий подход используют, наверняка.

Я не прошу исправить, я понимаю, что проблема где-то на системном уровне, которым должен заниматься жёлтый вендор. Но он, в лице С. Нуралиева, объявил, что развивать Конфигуратор не будет.

Я не прошу исправить, я понимаю, что проблема где-то на системном уровне, которым должен заниматься жёлтый вендор. Но он, в лице С. Нуралиева, объявил, что развивать Конфигуратор не будет.

14.05.26

✎

09:43

Проблема с ИИ в 1с в том, что система закрыта: закрыт код , информация закрыта (ИТС).

Да и по большому счету, фирме 1с это не нужно. Зачем это ей? Быстрее генерировать код? Любой коммерческой организации, которая занимается продажами нужно не быстрее, а дороже.

Применять новые технологии (в том числе ИИ) потому что конкуренты их применяют? У 1с нет конкурентов.

Будь я на месте Нуралиева - я бы еще больше закрыл и код и инфу. Ибо нефиг!

Да и по большому счету, фирме 1с это не нужно. Зачем это ей? Быстрее генерировать код? Любой коммерческой организации, которая занимается продажами нужно не быстрее, а дороже.

Применять новые технологии (в том числе ИИ) потому что конкуренты их применяют? У 1с нет конкурентов.

Будь я на месте Нуралиева - я бы еще больше закрыл и код и инфу. Ибо нефиг!

14.05.26

✎

12:02

(259) Да, проблема известная, аналогичная как у турбоконфа, 1.1.7 должна будет быть постабильнее.

14.05.26

✎

12:22

(260) Сначала у тебя нет конкурентов, а потом нет клиентов

14.05.26

✎

12:39

жЫза!

14.05.26

✎

18:26

(263)То есть у нас всё будет норм получается, так?

гуру

14.05.26

✎

19:01

(264) Смотря где

Как понял пока нет ни одной вменяемой типовой конфы зарубежной

Чтобы код внутри был не на русском языке

Пробовали переводить и ERP WE и Perform на английский - там куча багов когда английская версия код

Поэтому только с английским интерфейсом юзают и то редко

Так что жесткий вендор-лок и привязка к ру

Как понял пока нет ни одной вменяемой типовой конфы зарубежной

Чтобы код внутри был не на русском языке

Пробовали переводить и ERP WE и Perform на английский - там куча багов когда английская версия код

Поэтому только с английским интерфейсом юзают и то редко

Так что жесткий вендор-лок и привязка к ру

14.05.26

✎

21:23

ИИ сыроват пока...

15.05.26

✎

08:18

(246) Если утрировать, то получится что вся автоматизация сводится к чат-ботам.

гуру

15.05.26

✎

10:05

Нашел полезную ссылочку кто локально модельки крутит

https://whatmodelscanirun.com/?gpu=rtx-5060-ti-16gb&qty=2&ctx=16&speed=10&ram=64

https://whatmodelscanirun.com/?gpu=rtx-5060-ti-16gb&qty=2&ctx=16&speed=10&ram=64

15.05.26

✎

10:52

(264) скорей всего да. Во первых большая часть вайбкодинга закрывается для сегмента "ру", 1С "помогатор" с EDT это поделка работающая по минимуму или вообще не работающая, если хоть какая то сложность промпта появляется. Во вторых, даже если работать с ИИ через ВПН, то программирование "на русском" это х10 потребления токенов. В третьих объем кода и структура текущих решений сжирает токены за день. И это при нормальной подписке "за 100". Ну и финал - на составление нормального промпта, что бы не было "галлюцинаций" у ИИ уйдет времени равносильное самостоятельного написания кода. Да и не факт, что полностью корректный промпт выдаст рабочий код, а не придется потратить сопоставимое время на доведения до рабочего состояния.

Где работает в 1С и хорошо работает и будет работать - документация по изменениям кода. Форматирование и структурирование доработок (а этим страдают многие одинесники, код и форматирование вырви глаз). Ну и хорошо зайдут спецам по тех. вопросам - парсинг ТЖ аж со свистом, даже сразу с советами. То есть где применить есть где. Но заменить программиста 1С оно в ближайшие 5 лет не сможет. Старичкам хватит уйти на пенсию ))

Где работает в 1С и хорошо работает и будет работать - документация по изменениям кода. Форматирование и структурирование доработок (а этим страдают многие одинесники, код и форматирование вырви глаз). Ну и хорошо зайдут спецам по тех. вопросам - парсинг ТЖ аж со свистом, даже сразу с советами. То есть где применить есть где. Но заменить программиста 1С оно в ближайшие 5 лет не сможет. Старичкам хватит уйти на пенсию ))

гуру

15.05.26

✎

11:03

(269) Есть риск как бы сам сегмент "ру" не закрылся совсем

С ведением учета на камешках и черточках на бересте

С ведением учета на камешках и черточках на бересте

15.05.26

✎

11:06

(270) да ну. Как то раньше жили при закрытом внешнем IT. Даже если заморозить "ру" IT на текущем уровне софта - "640 килобайт памяти хватит всем" (С)

гуру

15.05.26

✎

11:11

(271) Речь не о заборе вокруг ларька

Сам ларек закрылся, точнее его закрыли владельцы

Предварительно выжав все что можно

И сдали площади в аренду...

Сам ларек закрылся, точнее его закрыли владельцы

Предварительно выжав все что можно

И сдали площади в аренду...

гуру

15.05.26

✎

11:13

(270) когда не было компуктеров

"Бухгалтерский учет до широкого внедрения вычислительной техники (примерно до конца 1980-х) был исключительно бумажным, ручным и жестко регламентированным процессом. Его основой были не программы, а деревянные счёты, журналы, чернильные ручки и высокая квалификация бухгалтера."

"Бухгалтерский учет до широкого внедрения вычислительной техники (примерно до конца 1980-х) был исключительно бумажным, ручным и жестко регламентированным процессом. Его основой были не программы, а деревянные счёты, журналы, чернильные ручки и высокая квалификация бухгалтера."

гуру

15.05.26

✎

11:19

зато щас ИТ в самом расцвете (временные ограничения и трудности/ссанкции со стороны вражын не считаются) - бардака в учете меньше не становится

"разруха не в клозетах"

"разруха не в клозетах"

гуру

15.05.26

✎

11:21

(274) так те головы в эти разрушенные клозеты не ходят

гуру

15.05.26

✎

11:30

(275) в ваших ибенях вас в каком месте в чем ущемили? или за державу обидно?

я вот вчера под белый список попал на мобильном тырнете (рядом завод какой-то). удаленка не работала, пока локацию не сменил

только маркеты типа яндекса и днс открывались. яндекс-нафигатор пробки не показывал. остальное - наглухо (мегафон, МТС, пчелайн)

я вот вчера под белый список попал на мобильном тырнете (рядом завод какой-то). удаленка не работала, пока локацию не сменил

только маркеты типа яндекса и днс открывались. яндекс-нафигатор пробки не показывал. остальное - наглухо (мегафон, МТС, пчелайн)

15.05.26

✎

11:29

(272) ой ли. У меня сейчас перед глазами IT службы трех огромных холдингов. Сократи 75% в ноль чем IT занимаются и бизнес и не заметит.

гуру

15.05.26

✎

11:31

(277) Это смотря кого сократить

Есть хороший анек про "Лоры, Доры, Жоры и Суки"

Есть хороший анек про "Лоры, Доры, Жоры и Суки"

гуру

15.05.26

✎

11:33

(276) Даже яндекс переводчик не работал?

В котором можно любой сайт выбрать для "перевода"

В котором можно любой сайт выбрать для "перевода"

15.05.26

✎

11:36

(277) [Сократи 75% в ноль чем IT занимаются и бизнес и не заметит.]

вылез из ВКС по ЭПД и прикинул уровень истерики директората огромного холдинга при моём сокращении =)

вылез из ВКС по ЭПД и прикинул уровень истерики директората огромного холдинга при моём сокращении =)

гуру

15.05.26

✎

11:41

(279) зачем любой ссайт?

мне нужен был корпоративный впн до рабочего места

мне нужен был корпоративный впн до рабочего места

15.05.26

✎

11:46

(228) А зачем подключение по COM добавлено? Опасаюсь, что я чего-то не использую, что можно. 😅

гуру

15.05.26

✎

11:47

(281) У вас не могут арендовать ip в белом списке или банально через cdn провайдера в белом прокинуть?

15.05.26

✎

11:49

(277) Ага. Не заметят примерно год. Потом будет больно и дорого.

15.05.26

✎

11:50

(280) ты оглянись вокруг и подумай, кого из товарищей безболезненно можно сократить ...

гуру

15.05.26

✎

11:57

Кстати возвращаясь к теме

Кто и через что использует нынче западные LLMки облачные с подписками?

Уточню что речь не про ВПН

А про интеграторов для удобства чтобы не париться и указав один URL разные модельки использовать с удобной оплатой

Кто и через что использует нынче западные LLMки облачные с подписками?

Уточню что речь не про ВПН

А про интеграторов для удобства чтобы не париться и указав один URL разные модельки использовать с удобной оплатой

15.05.26

✎

11:57

(282) А, все. Разобрался. 👍

15.05.26

✎

12:10

(285) не соскакивай с темы, бизнес крайне чувствителен к потере топовых ИТ-шников и сказки про "отряд не заметил потери бойца" из 90-х

15.05.26

✎

12:14

(288) в чем соскок? Ты пришел носом поворочал, я "важный" меня нельзя. Хорошо, что ты так считаешь. Я уверен тебя можно под зад коленом и переложить твои функции на другого. Ну пусть, есть работники, которых сложно заменить и они нужны - потому что ... впиши условия. Но большая часть IT сейчас это раздутые ни кому не нужные специалисты. Просто так сложилось.

15.05.26

✎

12:17

(288) ну и вдогонку твоей "важности" ты последние пару часов вообще не работаешь, а пишешь на мисте - это легко отследить ...

15.05.26

✎

12:27

(289) докажи: Я уверен, большая часть, так сложилось - темой не владеешь, реальную картину мира не представляешь

(290) поржал, в каком горячечном сне руководители проектов однозадачны

(290) поржал, в каком горячечном сне руководители проектов однозадачны

гуру

15.05.26

✎

12:42

(283) банально в офис начать ездить.

так дешевле для корпорации, чем арендовать что-то где-то

разбаловались с ковидлой - это она всех на удаленку загнала. а что, так можно было?

так дешевле для корпорации, чем арендовать что-то где-то

разбаловались с ковидлой - это она всех на удаленку загнала. а что, так можно было?

гуру

15.05.26

✎

12:48

(292) Дешевле?

Рабочее место в офисе в Мск, вместо отправки ноута?

С московскими заплатами вместо региональных?

И да вымывать всех вменяемых спецов из регионов - было мейнстримом задолго до ковида

Ковид просто окончательно продавил сопротивление рукамиводителей

Рабочее место в офисе в Мск, вместо отправки ноута?

С московскими заплатами вместо региональных?

И да вымывать всех вменяемых спецов из регионов - было мейнстримом задолго до ковида

Ковид просто окончательно продавил сопротивление рукамиводителей

гуру

15.05.26

✎

13:02

(293) в нашем случае да, т.к. офис есть, а вот сотрудники некоторые на удаленке. До ковидлы удаленки не было в принципе (считалось чем-то неприличным)

гуру

15.05.26

✎

13:07

(294) Если офис уже есть и нет разницы в зарплатах (сотрудники и так местные)

То согласен что загнать обратно в офис есть смысл

Но не особо большой

Ибо ИБД можно и в офисе под камерами заниматься

Но зато сотрудник свалив в 18:00 может смело забить на все и даже не отвечать на звонки и сообщения

В отличие от удаленки, где часто рабочий день становится ненормированным

То согласен что загнать обратно в офис есть смысл

Но не особо большой

Ибо ИБД можно и в офисе под камерами заниматься

Но зато сотрудник свалив в 18:00 может смело забить на все и даже не отвечать на звонки и сообщения

В отличие от удаленки, где часто рабочий день становится ненормированным

15.05.26

✎

15:58

(286) ага, например openrouter.ai

гуру

15.05.26

✎

16:04

(296) https://habr.com/ru/news/1034012/

OpenRouter перестал принимать платежи для учеток с регионом Россия

OpenRouter перестал принимать платежи для учеток с регионом Россия

15.05.26

✎

18:26

(286) Оплата от физика?

гуру

15.05.26

✎

18:46

(297) вроде только к openai, claude и gemini

гуру

15.05.26

✎

19:34

(298) Ну да

Юрики всегда могут провести оплату через физика

Юрики всегда могут провести оплату через физика

15.05.26

✎

21:15

(297) shit, да действительно, пару недель назад работало. Я чаще Z.AI пользую напрямую а в опенроутере дорогими моделями пользовался, но реже. Теперь самому интересно какая альтернатива ибо наши типо гидрыИИ еще дороже.

гуру

15.05.26

✎

21:20

(301) ботхаб.ру есть

но дорого, хотя и дико удобно

но дорого, хотя и дико удобно

15.05.26

✎

23:27

16.05.26

✎

10:23

(293) у разрабов уже выровнялись ЗП между Москвой и регионами.

гуру

16.05.26

✎

10:53

(304) Сфигали?

https://arkhangelsk.hh.ru/vacancy/132988552

Вот тут я работал 17 лет назад, прогом 1С 7.7 и 1С 8.1

И да там начальник ИТ-отдела (официально, если без откатов) получает меньше обычного разраба на удаленке

Но начальника легко найти, за забором очередь

А вот нормальных прогов не очень, они предпочитают на удаленке в 2-3 раза больше получать чем в регионе предлагают

https://arkhangelsk.hh.ru/vacancy/132988552

Вот тут я работал 17 лет назад, прогом 1С 7.7 и 1С 8.1

И да там начальник ИТ-отдела (официально, если без откатов) получает меньше обычного разраба на удаленке

Но начальника легко найти, за забором очередь

А вот нормальных прогов не очень, они предпочитают на удаленке в 2-3 раза больше получать чем в регионе предлагают

16.05.26

✎

13:00

(305) работы за копейки полно и в Москве для эникейщиков, которых в вакансиях называют программистами 1С.

Благодаря удаленке разраб из региона может работать на московскую или любую другую федеральную компанию из своего региона.

У меня в отделе только один москвич, остальные из регионов из ЗП у них одинаковая.

Сейчас не нужно как 20 лет назад с чемоданом ехать в Москву и ходить в офис, чтобы хорошую ЗП получать.

Помимо Москвы есть другие города, где ЗП на уровне.

Благодаря удаленке разраб из региона может работать на московскую или любую другую федеральную компанию из своего региона.

У меня в отделе только один москвич, остальные из регионов из ЗП у них одинаковая.

Сейчас не нужно как 20 лет назад с чемоданом ехать в Москву и ходить в офис, чтобы хорошую ЗП получать.

Помимо Москвы есть другие города, где ЗП на уровне.

гуру

16.05.26

✎

13:08

(306) Нет

Там именно программист 1С нужен за 85к в месяц

Эникейщиков еще за меньшие суммы нанимают в регионах

Там именно программист 1С нужен за 85к в месяц

Эникейщиков еще за меньшие суммы нанимают в регионах

16.05.26

✎

14:40

(307) помню, помню ... "Заводу в стадии санации требуется герой - новый начальник IT! Знания сетевого оборудования Циско, станков с ЦПУ, 1С, SAP обязательно!!!"

naïve

16.05.26

✎

18:55

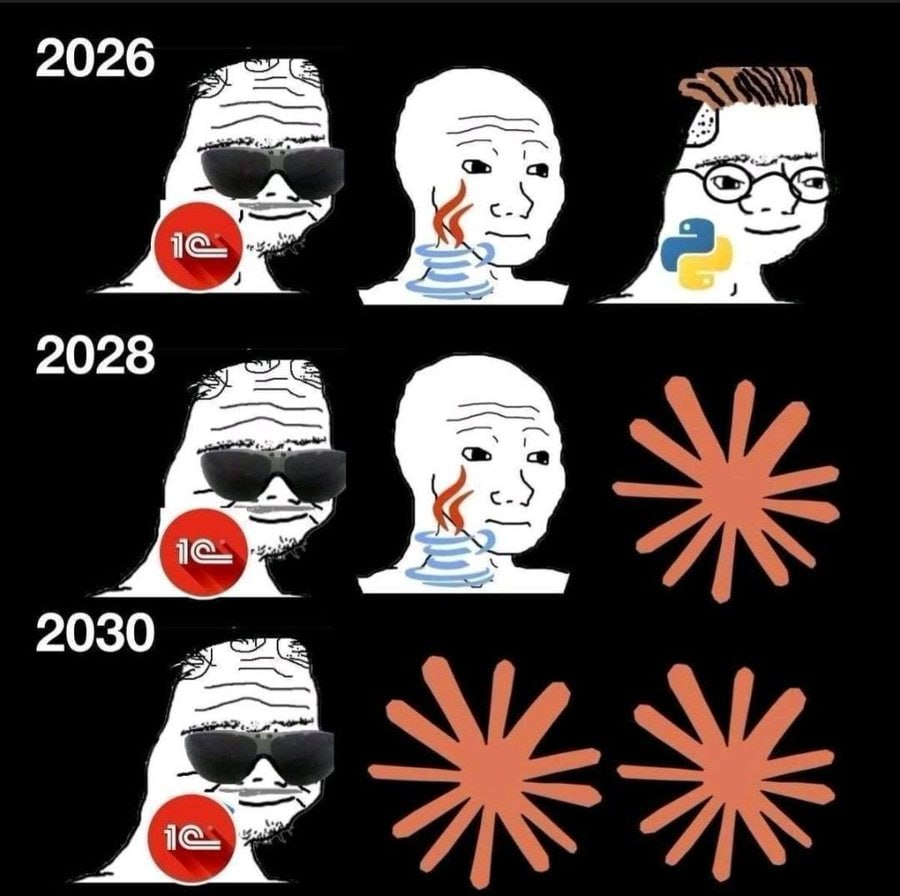

(263) так чем же все таки закончился эксперимент по телепортации программистов 1С на территорию, где есть только Ява и Питон?

naïve

16.05.26

✎

19:04

(252) дайте определение функции гладкости при использовании нейросети.

Зы. Ты хоть в курсе, что нормальный промт-инженер должен быть фактически еще и архитектором кода и QA инженером по верификации.

А также знать все свойства сходимости и устойчивости кода.

И уже потом копипасить в VS Code.

А то поразвелось тут так называемых экспертов, которые пишут промт:

Сделай аналог УПП без багов

и потом удивляются что код

не компилируется

Зы. Ты хоть в курсе, что нормальный промт-инженер должен быть фактически еще и архитектором кода и QA инженером по верификации.

А также знать все свойства сходимости и устойчивости кода.

И уже потом копипасить в VS Code.

А то поразвелось тут так называемых экспертов, которые пишут промт:

Сделай аналог УПП без багов

и потом удивляются что код

не компилируется

гуру

16.05.26

✎

20:03

(308) Там почти 9 лярдов выручка за 2025 и чистая прибыль 32 ляма

До санации далеко

До санации далеко

17.05.26

✎

09:07

чистая прибыль ~0.4% от выручки? объект на грани балансирует...?

гуру

17.05.26

✎

09:41

(312) ГУП же

Если большую прибыль показать то субсидий не дадут

Что выводить через откаты?

И убыток показать нельзя - не Почта России ))

И не Автоваз

Если большую прибыль показать то субсидий не дадут

Что выводить через откаты?

И убыток показать нельзя - не Почта России ))

И не Автоваз